30 мая в российский прокат выходит новый фильм продюсерского тандема Андреасянов «Манюня: Приключения в Москве», в котором «снимется» Юрий Никулин. Легенду советского кино оживят с помощью нейросетевых технологий. Создатели фильма даже получили согласие от семьи артиста на использование его образа в картине, но всё это снова вывело общественность на дискуссию об этических границах использования нейросетей. Самого Никулина-то уже не спросить.

За последние несколько лет нейросети проделали гигантский путь: если еще в конце 2010-х кривоватым дипфейкам мог поверить только невнимательный пользователь и зритель, а глубокие и детальные цифровые слепки реальности оставались прерогативой компаний, располагающих серьезнейшими вычислительными системами и командами профильных спецов, то сейчас генерация фото и видео высокого уровня – буквально забава, не требующая от человека за компьютером буквально ничего, кроме умения составлять правильные и достаточно детализированные промпты и ориентирования в сервисах.

Пару лет назад создание кривоватых нейрокартинок с аномальным количеством пальцев и сомнительными лицами было доступно в чат-ботах некоторых сервисов, количество генераций было ограничено, а сам набор платформ был крайне скромным, но даже тогда иски за фейки сыпались регулярно и, чаще всего, безответно. Сегодня платформ, с помощью которых можно сделать детализированное и крайне правдоподобное изображение вполне достаточно, серверных мощностей у них тоже хватает, а настольные дистрибутивы некоторых из них позволяют задействовать пользовательские устройства и забыть о проблемах на том конце провода или пейволлах. И здесь вопросы начали задавать уже графические дизайнеры, художники, видеографы.

Очевидно, что развлечение превратилось в индустрию. Которой требуется регулирование.

Обойдемся без художника

В начале 2023 года американский юрист и типограф Мэттью Баттерик инициировал судебное разбирательство, ответчиками в котором должны выступить разработчики нейросетей Midjourney и Stable Diffusion, а также платформа DeviantArt. Знаток авторского права планировал представлять интересы реальных художников. На тот момент троих – Сары Андерсен, Келли МакКернан и Карлы Ортиз. Но, по мнению Баттерика, потерпевших гораздо больше.

Юрист и означенные художники уверены, что создатели нейросетей, способных за считанные секунды нарисовать любое изображение по заданным тегам, попросту обокрали «миллионы художников». И дело тут не столько в том, что для множества проектов реальный художник уже попросту не нужен: нейросети должны обучаться. А учились они, как отмечают типограф и художники, именно на работах реальных людей. Не получив никакого на это согласия.

«По мере того, как я узнавал больше, как работают глубоко эксплуатирующие ИИ медиамодели, я понял, что нет никакого юридического прецедента, который бы установил это право. Давайте изменим это», — приводит слова Мэттью Баттерика издание The Verge.

Однако, от нарушений прав всё в любом случае сводится к потенциальной востребованности художников и дизайнеров. У юриста есть свой блог, в котором он на это довольно прозрачно намекает: вместо того, чтобы «наводнять рынок практически неограниченным количеством контрафактных изображений, что нанесет ущерб рынку искусства и художникам», Баттерик призывает сделать ИИ «справедливым и этичным».

А вот что значит «справедливым и этичным» – вопрос, на который все еще нет ответа. Это был первый иск такого рода, за ним последовало еще несколько, однако каких-то явных результатов это не принесло: стороны так и не пришли к какому-либо согласию. Но проблема, озвученная Баттериком, реальна: нейросеть и чат-бот действительно нельзя воспринимать как цифрового художника. Каждая из графических генеративных сетей, прежде чем выйти на рынок, обучалась на тысячах и тысячах произведений, созданных человеком, а после – оттачивала навыки уже на своих успешных генерациях. Так, к примеру, устроен Leonardo.Ai – платформа, кроме непосредственно инструмента генерации, оснащена своего рода галереей, где пользователи могут выставлять свои работы. И на этих работах сетка продолжает учиться. Более того, в промпте можно указывать стиль конкретного художника – как творца, работающего с кистями и холстами, так и автора из отрасли диджитал-арт.

Таким образом, генерация – это только отчасти создание уникального изображения. Во всем остальном – это компиляция из уже существующих деталей, которые нейросеть преобразует и расставляет в определенную композицию. То же самое касается генерации, в которой фигурируют реальные личности, изображения с их участием собираются из массива выгруженных в сеть фотографий, на которые, скорее всего, у кого-то есть авторские права. В совокупности это выглядит это начинает выглядеть как чистой воды плагиат. Причем, плагиат, с которым невозможно бороться, и начинать применять существующие параграфы всевозможных правовых документом и юридических норм, всё уже случилось. Тут остается только напрочь запрещать генеративные нейросети, что тоже уже невозможно: это гигантский рынок, а его игроки финансово преуспели настолько, что OpenAI в ближайшем будущем планирует превратиться в еще одного IT-гиганта и составлять конкуренцию старожилам в области разработки и торговли гаджетами.

Художник все еще бывает нужен. Для доработки нагенерированного всё еще остро нужны навыки владения пакетом «Фотошопом» или его более доступными аналогами, а компании побольше связаны по рукам и ногам все теми же путами авторского права: им нужен собственный забрендированный контент. Но это – островок в море повального использования генеративных нейросетей. Для оценки масштаба достаточно приглядеться к баннерной рекламе в метро и на улице, каждая вторая картинка – генерация. Prime Video использует для создания постеров к новым проектам нейросети и даже не заботится об их исправлении: посмотрите на первый постер к грядущему сериалу «Фоллаут».

Художник всё еще нужен для доработки и масштабирования проекта: нейросеть сможет дать идею логотипа вашей компании, но для ее реализации все же нужен человек, владеющий «Иллюстратором» и «Индизайном». В остальном – до свидания, мы вам перезвоним.

Обойдемся без писателя

Ряд ведущих мировых СМИ, таких как CNN, BBC, NYT и десяток крупных новостных агентств еще несколько лет назад провели серию тотальных увольнений сотрудников. Новостные отделы изданий покинули десятки и десятки новостников. Оказалось, что если человека в кресле за компьютером, которому нужно с подергивающимся глазом выдавать за смену десяток-другой тысяч знаков коротких информационных заметок, походя оптимизируя их под запросы поисковиков и мечтая перейти на позицию поприятнее, заменить на чат-бот, который будет это делать бесплатно и в сотни раз быстрее, то выйдет большая экономия. А хуже не станет – всё равно новостник на определенной стадии своего развития начинает напоминать всю ту же текстовую нейросеть, которой нужно ухватить описание, срерайтить его до нужного процента уникальности, тиснуть заголовок по ТЗ и кинуть это в ленту. Либо кинуть куском полумашинного текста в бильда или выпускающего редактора. Тогда зачем нам человек-машина, если он просит денег, ходит на перекур и хочет перестать заниматься тем, чем занимается?

Красивая гипотеза говорит о том, что с развитием технологий все рутинные процессы можно будет переложить на машину, а человеку останется только чистое творчество, в которое он и сможет погрузиться с головой. Беда в том, что этого чистого творчества в общей массе задач творческих профессий – пара-тройка процентов. Всё остальное как раз и является творческой рутиной. Слоганы, заметки, дайджесты, фичеры, пресс-релизы, даже несложные статьи – всё это можно доверить текстовой нейросети. Рассказы, стихи, зарисовки для постов в телеграм-каналах – тоже. А чем-то более сложным и насыщенным творческими искрами занимается каждый сотый в творческой профессии. Остальным, видимо, нужно проходить курсы профессиональной переподготовки и идти в IT. Ой, но ведь и там строки кода на уровне джуна уже тоже пишут нейросети! Неловко вышло.

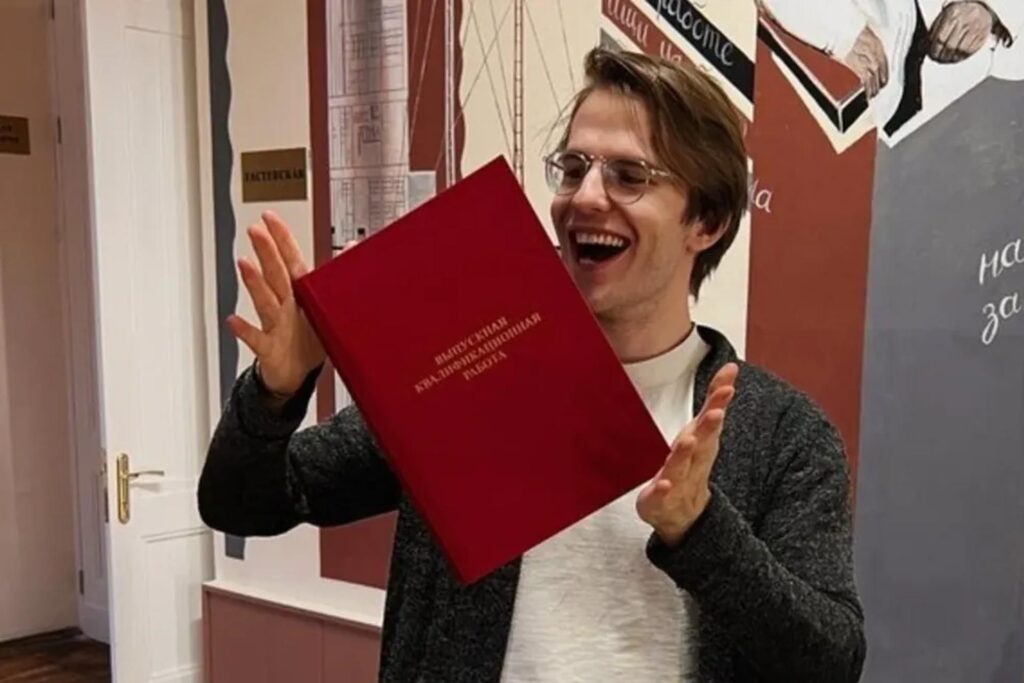

У нас одна из самых громких историй, связанных с использованием нейросетей при написании чего-либо – это прошлогодний выпуск в РГГУ, когда Александр Жадан написал свою ВКР при помощи ChatGPT. Бакалавр тогда скормил чат-боту методические рекомендации, а затем с помощью еще нескольких запросов получил от нейросети введение, первую – теоретическую – главу, список использованной литературы. Для второй, практической главы, студент показал ChatGPT уже существующую аналогичную работу, которую чат-бот адаптировал под текущее задание. На всё ушло порядка 23 часов. Кто-то писал ВКР быстрее?

Был изрядный скандал, в РГГУ хотели аннулировать диплом, дело дошло до Минобрнауки, в ведомство с письмом обратилась Национальная комиссия по этике в сфере искусственного интеллекта. Правда, требования были рациональными – дать оценку и принять меры к регламентированию использования нейросетей хотя бы в образовании. И определить, когда использовать чат-боты можно, а когда нельзя.

«Использование таких технологий может быть уместно и полезно для освоения отдельных специальностей и навыков и в ряде случаев не будет противоречить обязанности студентов выполнять работу самостоятельно», — говорилось в письме.

Воз и ныне там. В некоторых вузах использование генеративных нейросетей для написания научных работ попросту запретили, в некоторых на это как не обращали внимания, так и не обращают. А в ВШЭ нейросети и вовсе поощряют: в начале апреля ректор ВШЭ анонсировал конкурс для выпускников, которые будут использовать нейросети при написании ВКР. Лучшие будут получать специальную стипендию в магистратуре, а те, кто останется с бакалаврским дипломом, смогут попасть на уже оплаченные курсы по ИИ. Условие всего одно: описать свои действия с нейросетью и дать им обоснование, комиссия будет оценивать сложность поставленных чат-боту задач и их уместность.

Обойдемся без живых

И, пожалуй, самое острое. Использование нейросетей для воскрешения кого бы то ни было. Чаще всего здесь речь идет, конечно, об актерах, музыкантах, известных личностях. Едва ли вообще кто-то может дать адекватную оценку этичности этих действий. Мертвых актеров оживлять повадились довольно давно, и здесь Голливуд был первым. Пол Уокер в седьмом «Форсаже» – трагическая автокатастрофа не дала команде Вина Дизеля сделать фильм таким, каким он задумывался, но дело нужно было довести до конца. Дизель, заручившись поддержкой семьи Уокера и будучи его ближайшим другом, принял решение оживить актера для его последней роли. Но тогда эта была чистая графика, нейросетей как таковых еще попросту толком не было. Кэри Фишер в новой трилогии «Звездных войн» – актриса успела сняться только в седьмом фильме франшизы, для восьмого использовали компьютерную графику вперемешку с зарождающимися генеративными технологиями. Владислав Галкин – актер не дожил до нового сезона «Диверсантов», но его роль там была слишком значимой. Его тоже «оживили». Тоже как будто с согласия.

Но «Манюня» – прецедент. Все примеры прошлого – это устоявшиеся франшизы, в которых замена актера будет критичным моментом. И нужно договариваться с совестью либо объяснять отсутствие героя сценарно. «Манюня» – новое кино. В котором Андреасянам зачем-то понадобился оживленный Никулин, который не может увидеть сценария, не сказать реплику так, как, может быть хотел бы. И не может отказаться от роли.

Живой человек может опровергнуть что-то, что не является правдой. Иногда это трудно, иногда фейк может разрушить прежнюю жизнь и нужно будет долго и муторно, кирпичик за кирпичиком восстанавливать и ее, и свое доброе имя. Всем же не объяснишь, что на самом деле это не правда. Не все еще и поверят. Мертвый этого сделать не сможет.

Этические границы использования нейросетей – острая необходимость. В OpenAI, готовясь к выпуску в общество своей новой сетки Sora, позволяющей делать просто невероятные вещи, попытались учесть вопросы безопасности и сомнения в адекватности пользователей. Но не пришли ни к чему кроме вотермарки поверх генерируемого контента и семантических ограничений, заложенных в саму нейросеть. Которые, очевидно, можно обойти – прецедентов хватает, иначе каждая из генеративных нейросетей не выдавала ежедневно тонны сомнительного с точки зрения морали контента.

Границы нужны. Осталось понять, кто имеет моральное право их выставить.